Anthropic’nin Claude’su İçin Yeni Gizlilik ve Eğitim Politikası: Kullanıcı Verilerinin Kullanımı Yeniden Tanımlanıyor

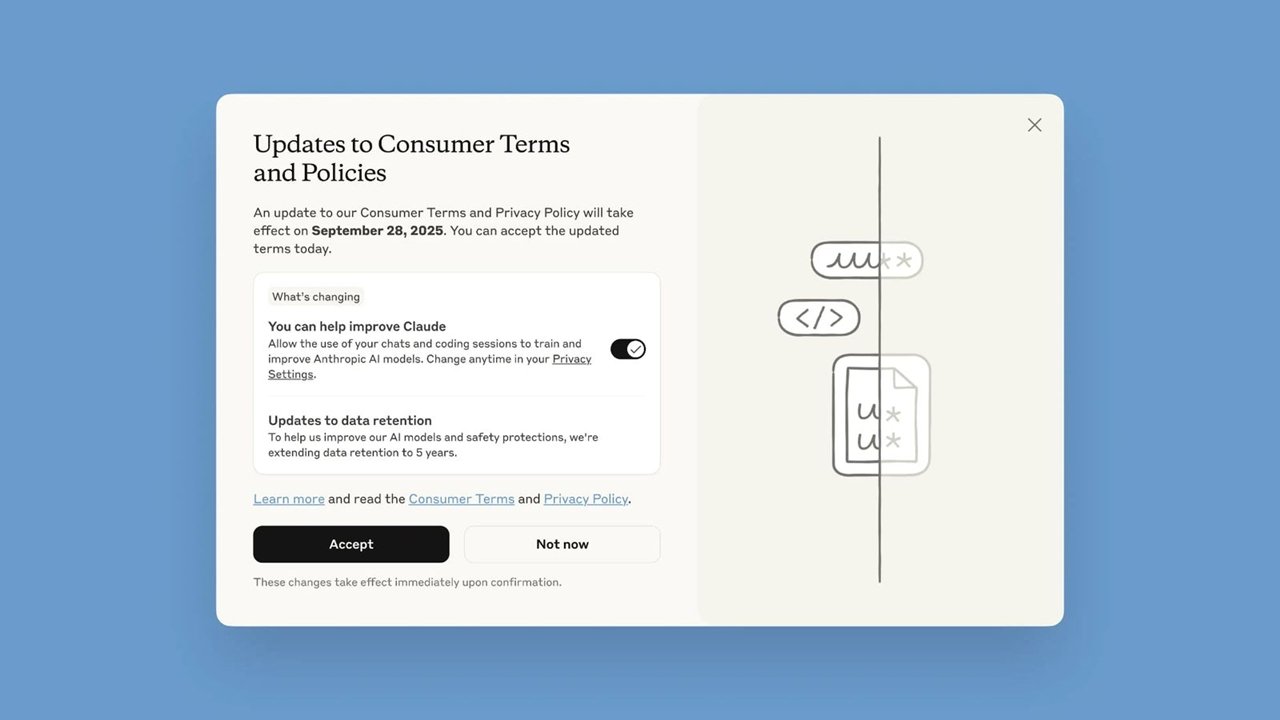

Yapay zekâ şirketi Anthropic, gizlilik politikasını güncellediğini duyurdu. Yeni politika ile sohbet botu Claude’un artık kullanıcıların sohbetlerinden eğitildiğini belirtirken, kullanıcıların rızası üzerinden veri paylaşımının nasıl işleyeceği netleşti.

Yeni kullanıcılara kayıt sırasında vazgeçme seçeneği sunuluyor; mevcut kullanıcılar ise kısa süre içinde gelecek bir bildirimle tercihlerini değiştirme imkanı bulacak. Eğer 28 Eylül tarihine kadar karar verilmezse, Claude’u kullanmaya devam etmek için şartları kabul etmek gerekecek.

Verilerin saklanması ve kullanımı konusunda güncel politika şu şekilde: sohbetleriniz eğitimi için paylaşmayı seçerseniz, bu veriler beş yıl boyunca saklanacak; ancak silinen konuşmalar gelecekteki eğitimlerde kullanılmayacak. Veri paylaşımını reddetmeniz durumunda ise sohbetleriniz, bugüne kadar olduğu gibi 30 gün süreyle tutulacak.

Şirket, kullanıcıların kişisel bilgilerini üçüncü taraflarla paylaşmadığını vurguluyor ve hassas verilerin uygun güvenlik araçlarıyla filtrelendiğini belirtiyor. Claude’un önce doğrudan kullanıcı geri bildirimleriyle eğitildiğini hatırlatan şirket, bu yeni dönemde sohbetlerin eğitimde çok daha önemli bir rol oynayacağını ifade ediyor.

Gizlilik tercihini yönetme için kullanıcılar, ayarlarda Gizlilik bölümüne gidip “Claude’u geliştirmeye yardımcı ol” seçeneğini kapatabilirler. Böylece sohbetleriniz model eğitimi amacıyla kullanılmaz. Şirket, bu yaklaşımın Claude’un yeteneklerini artıracağını ve dolandırıcılık gibi zararlı kullanımlara karşı koruma sağlayacağını belirtiyor.