OpenAI ve Cerebras İş Birliğiyle Kodlama İçin Yeni Hız Sınırları

OpenAI, işletim hızını artırmak için Cerebras ile güçlerini birleştirdi. GPT 5.3 Codex Spark sürümünün kodlama yüklerinde, Cerebras tarafından üretilen çiplerin kullanıldığını açıkladı. Bu adım, özellikle çıkarım süreçlerinde düşük gecikme ve yüksek işlem hızı arayan geliştiriciler için pazarın dinamiklerini değiştirme potansiyeline sahip.

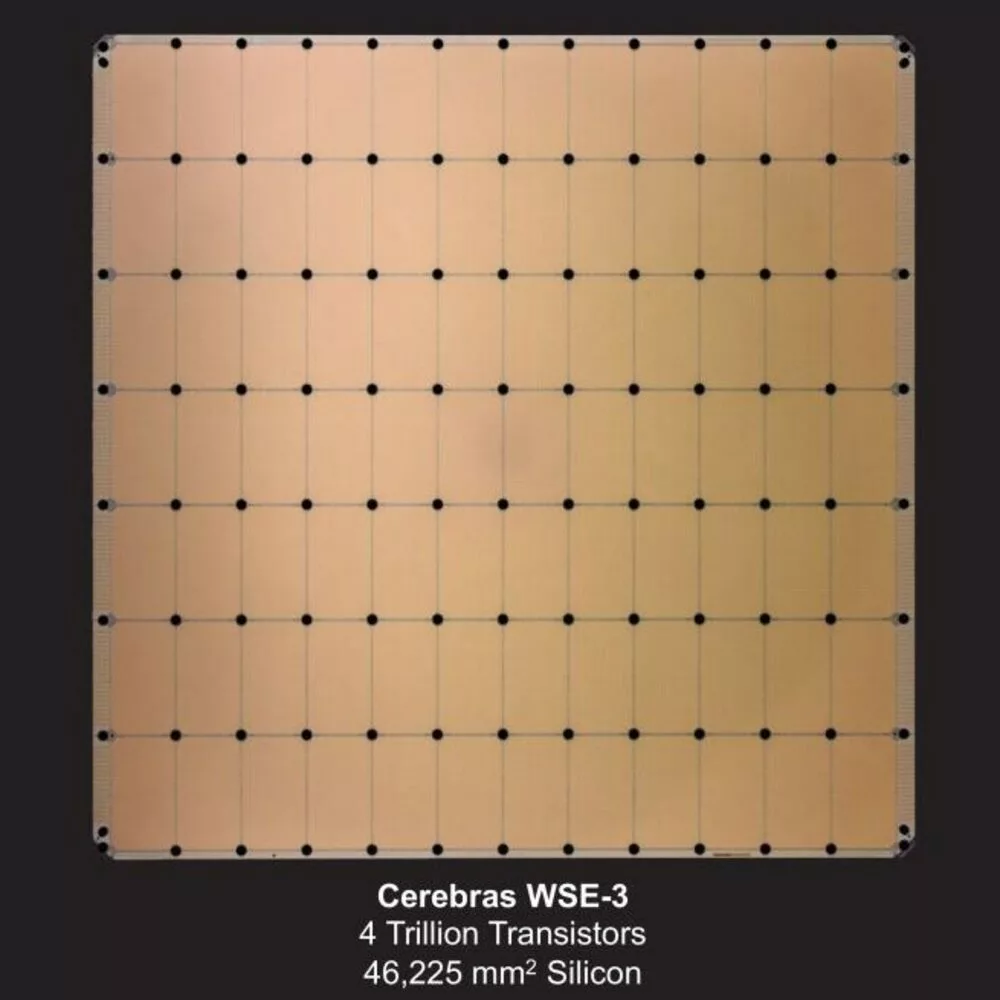

Kodlama Performansında Sıçrama Yeni modelin saniyede binlik işlem kapasitesine ulaşması, insan düzeyinde hızlı yanıtlar sunan bir programlama deneyimini andırıyor. Bu başarının arkasında, TSMC’nin 5 nanometre teknolojisiyle üretilen ve 4 trilyon transistor barındıran Cerebras Wafer Scale Engine 3 yer alıyor. Bu çip, bellek bant genişliğindeki sınırları aşarak veriye ilk ulaşımı hızlandırıyor ve OpenAI bu sayede bu süreyi önemli ölçüde azaltabildiğini iddia ediyor.

Gecikme Kritik Öneme Sahip NVIDIA’nın Blackwell mimarisi toplu işlemlerde maliyet avantajı sunsa da, tekil kod tamamlama hareketlerinde gecikme kullanıcı deneyimini doğrudan etkileyebiliyor. Cerebras donanımının sunduğu geniş bellek bant genişliği, kodlama iş yüklerinde hayati rol oynuyor ve bu tercihin ekonomik olarak da mantıklı olduğu belirtiliyor.

Pazarda NVIDIA Tekeli Kırılıyor mu? Eğitim süreçlerinde hâlâ liderliğini sürdüren NVIDIA’ya karşı, çıkış tarafında rekabet kızışıyor. Cerebras ve benzeri oyuncuların sahneye çıkması, OpenAI gibi büyük oyuncuların alternatif çipleri ana akım modellerinde kullanmaya başlamasıyla sektörde kartların yeniden dağıtılmasına yol açabilir. AMD ve diğer ASIC üreticilerinin de bu yarışa dahil olmasıyla donanım pazarında çeşitlilik artışı bekleniyor. Sizce diğer yapay zeka şirketleri de NVIDIA yerine alternatif çip üreticilerine yönelir mi? Görüşlerinizi bizimle paylaşın.